ドワンゴメディアヴィレッジでインターンをしておりました、幾田(http://woodrush.github.io/)です。ドワンゴメディアヴィレッジでは、機械学習、3DCG、コンピュータビジョンなどの分野の研究開発を行っています。

2016年12月5-8日に開催された SIGGRAPH Asia 2016 にて、“Blending Texture Features from Multiple Reference Images for Style Transfer” という題名でTechnical Briefを発表しました。実装コードや発表スライドなどを nico-opendata内の応用事例記事「複数参照画像を用いた画風転写」 で公開しています。

この記事では、発表内容の概要を紹介します。

本研究は[Gatys2016]の研究を拡張したもので、「ある画像を与えられた別の画像群の画風で描き直す」というシステムです。

ある画像を別の画風で書き換える事は、デザインなどの分野で広く求められています。例えばアニメーション製作では、背景の製作のため、実際の写真を参考にそのアニメーションに合った画風で描き直す事があります。この際、写真を描き直す作業は人手で行っています。本研究は、

ということを目的および特徴としています。具体的には、上図のように

を入力すると、

が得られるような方法を提案しました。

L. A. Gatys, et al.の研究との差分は、「画風は1枚の画像ではなく、その画風に属する多くの画像によって指定される」という点に基づき、画風の例として多くの画像を用いることで、より自然な画風転写ができるという点です。更に、それをnico-illustデータセットという新しいデータセットによって検証しました。以下に、先行研究との差分を詳しく紹介します。

L. A. Gatys, et al.の先行研究では、画風の参照として用いる画像は1枚であるため、その画像の色の分布に、変換結果自体の色の分布が大きく左右されてしまうという性質がありました。

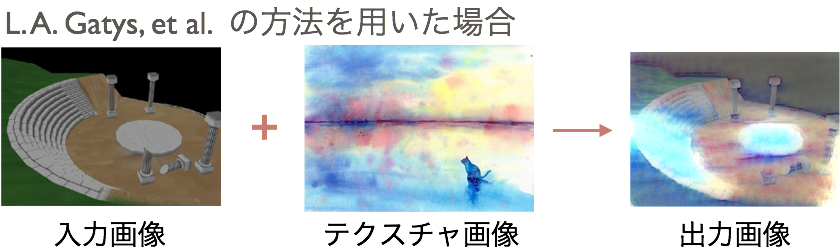

上の図は、L. A. Gatys, et al.の方法を用いて**「水彩風」への変換**を試みた例です。この画像では、

以上のことが起こる理由として、本研究では**「水彩風」という画風は画像1枚では説明できないため**という説明を与えました。つまり、水彩風の画像を1枚与えられただけでは、その画像が「水彩風」である根拠が、そのテクスチャに由来するのか、あるいは色使いに由来するのか、などが区別できないということです。

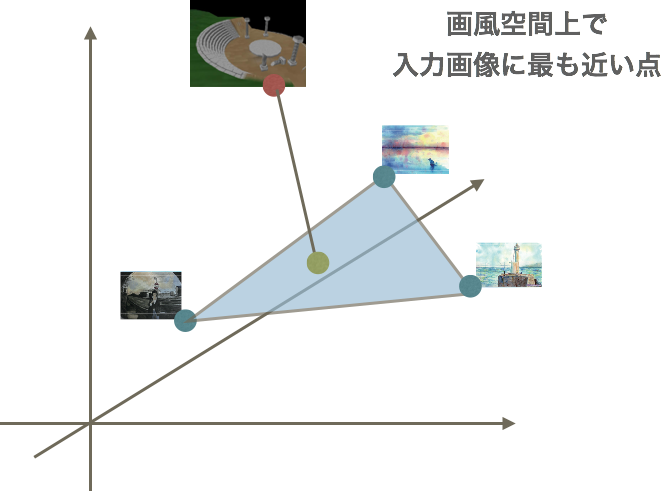

これを解決するために、本研究では多くの画像を用いて画風を説明する方法を提案しました。L. A. Gatys, et al.の方法では、画像テクスチャや色の情報を含む特徴量を用いて画風変換を行っています。本研究ではこの特徴量をテクスチャ特徴量と呼んでいます。L. A. Gatys, et al.の方法では、入力画像のテクスチャ特徴量を計算し、それをそのまま画風転写に用いていました。これに対し本研究では、テクスチャ画像群の画像のそれぞれのテクスチャ特徴量を計算し、それらを混合することで、入力画像に対して最適なテクスチャ特徴量を求め、それをテクスチャ転写に用いています。この操作の根拠として、

を行いました。以上の2点より、同じ画風に属する画風のテクスチャ特徴量の線形結合により、その画風を表すテクスチャ特徴量を自由に生成できるというのが、本研究の主な主張です。この時生成されるテクスチャ特徴量の集合を画風空間と呼びました。これを用いて、

というのが本研究の手法です。以上を表したのが下図です。

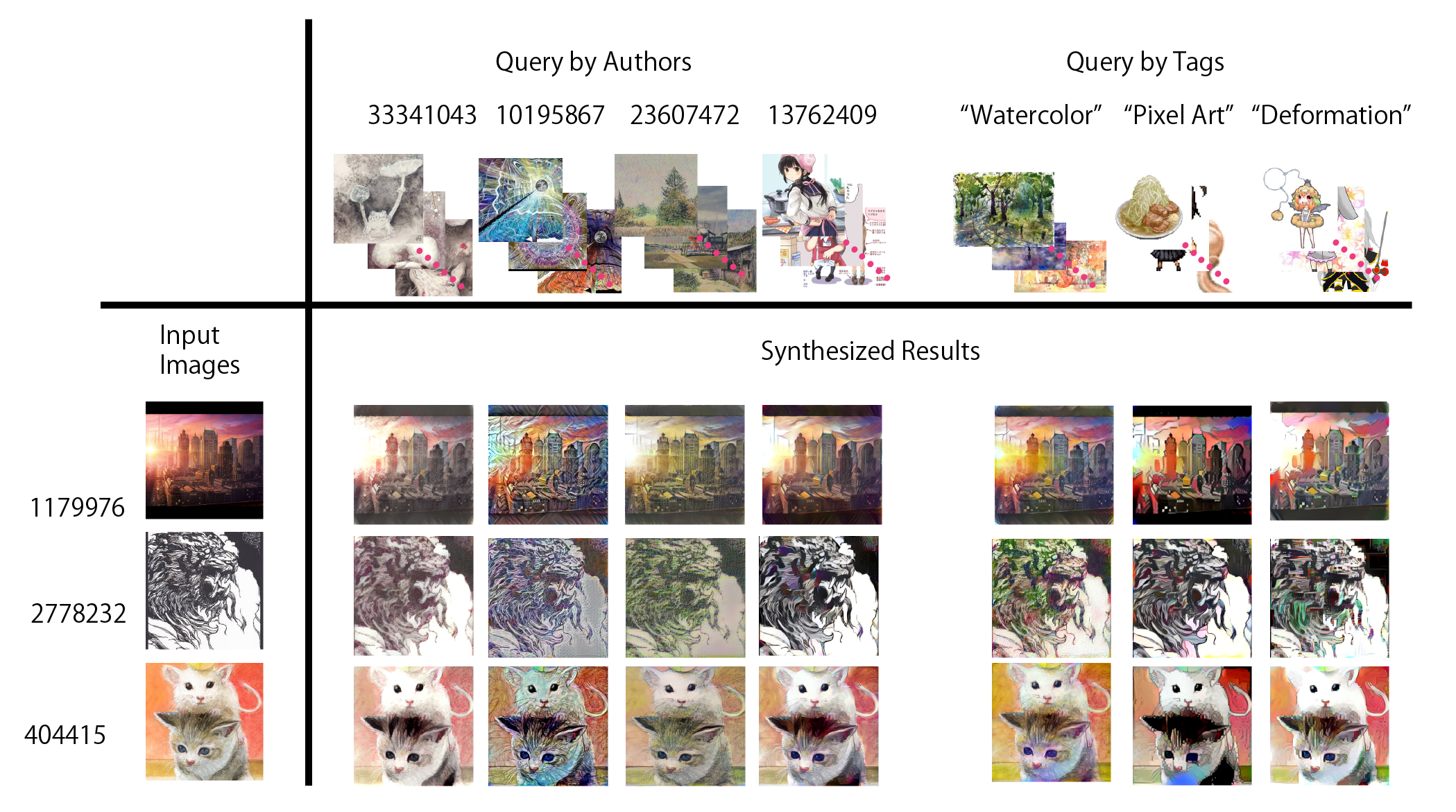

本研究による出力結果の一覧が下図です。

本研究では以下のような実装・実行環境を用いて画像生成を行いました。

実装:

実行環境:

まず実装についてですが、実際に用いる際には予め学習した何かしらの画像認識用のニューラルネットワークが必要になります。今回は、Simonyan, et al. のVGGを用いました。その他、コードの実装をする上で、Preferred Research ブログの 画風を変換するアルゴリズム の記事を参考にさせていただきました。

nico-illustデータセットとは、ドワンゴで公開 しているnico-opendataデータセットのうちの、ニコニコ静画に投稿された静画データセットで、

等各画像の様々な情報を含んでいます。

本研究では、これらの中から特にタグおよび著者の情報を使用しました。ニコニコ静画におけるタグは、「水彩」「ドット絵」など、その画像が描かれている画風が付けられている場合があります。このことを利用して、ある画風で描かれた画像を多くクエリしました。また、著者の情報を用いて、その著者の画風を転写することも試みました。

今回のドワンゴメディアヴィレッジでのインターンでは、多くの方の助けを頂き、最終的には結果をまとめて学会発表をさせて頂く機会も頂きました。今回のインターンを通し、非常に多くの事を学び、また楽しく研究開発をすることができました。この場を借りて、皆様に感謝の意を表したいと思います。ありがとうございました。

[Gatys2016] GATYS, L. A., ECKER, A. S., AND BETHGE, M. 2016. Image style transfer using convolutional neural networks. In Proceedings of IEEE Computer Vision and Pattern Recognition. http://ieeexplore.ieee.org/document/7780634/

[Simonyan2015] SIMONYAN, K., AND ZISSERMAN, A. 2015. Very deep convolutional networks for large-scale image recognition. In Proceedings of International Conference on Learning Representations. https://arxiv.org/abs/1409.1556

[PreferredResearch2015] Preferred Research ブログ, 画風を変換するアルゴリズム. https://research.preferred.jp/2015/09/chainer-gogh/